Jede erfolgreiche SEO-Strategie steht und fällt mit ihrer technischen Basis. Eine fundierte technische SEO-Analyse ist also kein „Nice-to-have“, sondern das absolute Fundament. Sie sorgt dafür, dass Suchmaschinen wie Google deine Website überhaupt erst finden, verstehen und indexieren können – die Grundvoraussetzung, um in den Suchergebnissen aufzutauchen. Ohne diese saubere technische Grundlage bleibt selbst der beste Content unsichtbar.

Warum saubere Technik das Fundament deines SEO-Erfolgs ist

Stell dir vor, du hast ein fantastisches Ladengeschäft mit erstklassigen Produkten, aber die Eingangstür ist winzig, kaum zu finden und die Gänge sind ein Labyrinth. Genau das passiert online, wenn du großartigen Content produzierst, aber die Technik deiner Website vernachlässigst. Die technische SEO-Analyse ist wie die Inspektion durch einen Architekten: Sie stellt sicher, dass Google & Co. nicht nur reinkommen, sondern sich auch mühelos orientieren können.

Technisches SEO ist auch keine einmalige Angelegenheit, sondern ein fortlaufender Prozess. Algorithmen entwickeln sich weiter, neue Technologien kommen auf und deine Website wächst. Ohne regelmäßige Checks schleichen sich schnell Fehler ein, die deine Sichtbarkeit leise, aber effektiv sabotieren.

Ein typisches Szenario aus der Praxis

Ein E-Commerce-Shop für Sportbekleidung steckte fest. Monatelang stagnierte der organische Traffic, obwohl das Team fleißig neue Produkte und Blogartikel online stellte. Sie investierten viel Herzblut in Content, doch die Besucherzahlen blieben frustrierend niedrig.

Erst eine tiefgehende technische Analyse deckte die wahren Bremsklötze auf:

- Fehlerhafte Canonical-Tags: Durch eine falsche Konfiguration im Shopsystem zeigten hunderte Produktvarianten auf sich selbst, anstatt auf die eigentliche Hauptproduktseite zu verweisen. Das Ergebnis? Massiver Duplicate Content, der Google komplett verwirrte.

- Langsamer Largest Contentful Paint (LCP): Riesige, unkomprimierte Produktbilder auf den Kategorieseiten führten zu Ladezeiten von über vier Sekunden. Viele Nutzer waren schon weg, bevor die Seite überhaupt fertig geladen war – ein katastrophales Signal für Google.

- Verwaiste Seiten (Orphan Pages): Einige der besten Ratgeberartikel waren intern kaum verlinkt. So wurden sie vom Googlebot nur selten besucht und konnten ihr enormes Potenzial gar nicht entfalten.

Solche Probleme sind alles andere als selten. Eine aktuelle Studie zeigt, dass 36 % aller deutschen Websites mindestens eine Seite mit einem 4XX-Fehler haben, was die Indexierung massiv stört. Ein weiteres, weit verbreitetes Problem ist fehlendes JavaScript-Minifying, das bei rund 50 % der Websites auftritt. Die gute Nachricht: Unternehmen, die solche technischen Mängel beheben, konnten ihren organischen Traffic um bis zu 20 % steigern. Mehr über solche SEO-Statistiken und ihre Bedeutung findest du auf seranking.com.

Technisches SEO schafft die Voraussetzungen dafür, dass deine inhaltlichen und strategischen Bemühungen überhaupt Früchte tragen können. Es ist die Sprache, die du sprechen musst, damit Suchmaschinen dir zuhören.

Am Ende des Tages wirkt sich die technische Gesundheit deiner Website auf alles aus: von der Indexierbarkeit über die User Experience bis hin zu deinen Conversion-Raten. Ein regelmäßiger technischer Audit ist also kein Luxus, sondern schlicht eine Notwendigkeit, um im Wettbewerb zu bestehen und das volle Potenzial deiner Website auszuschöpfen.

Die entscheidenden Bereiche deiner technischen Analyse

Eine gründliche technische SEO-Analyse ist kein Hexenwerk, sondern eine systematische Untersuchung. Stell es dir wie den TÜV für deine Website vor: Wir gehen durch eine Reihe kritischer Bereiche, die zusammen das technische Gerüst bilden. Es geht darum, sicherzustellen, dass Suchmaschinen wie Google deine Inhalte nicht nur finden und verstehen können, sondern sie auch positiv bewerten.

Das Wichtigste dabei: Jeder Bereich hängt mit dem anderen zusammen. Schwächen in einem Teil können die Stärken eines anderen komplett zunichtemachen. Deswegen fangen wir immer beim absoluten Fundament an: der Crawlbarkeit und Indexierbarkeit. Wenn das nicht sitzt, ist der Rest praktisch umsonst.

Bevor wir in die Details der einzelnen Prüfpunkte eintauchen, gibt diese Tabelle einen schnellen Überblick. Sie zeigt die Kernbereiche und hilft dir, von Anfang an die richtigen Prioritäten zu setzen, je nachdem, wo der Schuh am meisten drückt.

Kernbereiche der technischen SEO-Analyse und ihre Priorität

Ein Überblick über die wichtigsten Bereiche einer technischen Analyse, geordnet nach ihrer unmittelbaren Auswirkung auf das Ranking und die Nutzererfahrung.

| Bereich der Analyse | Fokuspunkt | Wichtigstes Tool | Priorität |

|---|---|---|---|

| Crawlbarkeit & Indexierung | Blockaden in robots.txt, noindex-Tags, Serverfehler (5xx) | Google Search Console | Sehr hoch |

| Seitenarchitektur | Klicktiefe, interne Verlinkung, verwaiste Seiten | Screaming Frog | Hoch |

| Core Web Vitals | LCP, INP, CLS – Ladezeit und Nutzerinteraktion | PageSpeed Insights | Hoch |

| Mobile-First | Responsives Design, Lesbarkeit, Klickbarkeit auf Mobilgeräten | Mobile-Friendly Test | Sehr hoch |

| Strukturierte Daten | Schema.org-Implementierung für Rich Snippets | Schema Markup Validator | Mittel |

| Sitemap & Robots.txt | Korrektheit, Vollständigkeit, keine unbeabsichtigten Regeln | Google Search Console, Screaming Frog | Hoch |

| Logfile-Analyse | Echtes Crawler-Verhalten, Crawl-Budget-Nutzung | Logfile-Analysator (z.B. Screaming Frog) | Mittel (Fortgeschritten) |

Diese Priorisierung ist natürlich ein Richtwert. Bei einem Relaunch rückt vielleicht die Architektur in den Vordergrund, während bei einer langsamen Seite die Core Web Vitals die höchste Dringlichkeit haben. Aber als Faustregel hilft diese Einordnung enorm.

Crawlbarkeit und Indexierung sicherstellen

Fangen wir bei den Basics an. Crawlbarkeit bedeutet schlicht: Kann der Googlebot auf deine URLs zugreifen oder steht ihm etwas im Weg? Indexierbarkeit ist dann der nächste Schritt: Darf Google die Seite nach dem Crawlen auch in seinen riesigen Index aufnehmen? Nur was im Index ist, kann ranken. Punkt.

Hier lauern oft die heimtückischsten Fehler. Eine falsch konfigurierte robots.txt-Datei kann blitzschnell ganze Bereiche deiner Website unsichtbar machen. Stell dir vor, eine Zeile wie Disallow: /blog/ schließt versehentlich alle deine wertvollen Artikel vom Crawling aus. Ein absoluter Super-GAU.

Genauso gefährlich sind die Meta-Robots-Tags. Ein kleines noindex auf einer wichtigen Kategorieseite – vielleicht ein Überbleibsel aus der Testphase vor dem Relaunch – und die Seite verschwindet komplett aus den Suchergebnissen. Das passiert öfter, als man denkt.

Deine allererste Aufgabe bei jeder technischen Analyse lautet: Finde und beseitige jede unbeabsichtigte Barriere für Suchmaschinen. Check die robots.txt und jage gezielt nach

noindex-Tags auf Seiten, die ranken sollen.

Die Architektur deiner Website optimieren

Eine gute Seitenarchitektur ist wie eine intuitive Beschilderung in einem großen Kaufhaus. Sie führt Nutzer und Suchmaschinen mühelos zum Ziel. Eine flache Hierarchie ist hier fast immer die beste Wahl – das bedeutet, dass deine wichtigsten Seiten mit nur wenigen Klicks von der Startseite aus erreichbar sind.

Die interne Verlinkung ist dabei dein wichtigstes Werkzeug. Sie verteilt nicht nur Link-Equity (manche nennen es auch „Link Juice“) auf deiner Seite, sondern zeigt Google auch, welche Seiten thematisch zusammengehören und welche besonders wichtig sind. Ein Blogbeitrag über „Laufschuhe für Anfänger“ muss einfach auf die passenden Produktseiten für Einsteigermodelle verlinken.

Ein No-Go sind „Orphan Pages“ (verwaiste Seiten). Das sind Seiten ohne interne Links, die wie einsame Inseln im Ozean deiner Domain treiben. Der Googlebot findet sie nur schwer oder im schlimmsten Fall gar nicht.

Core Web Vitals und Seitengeschwindigkeit meistern

Die User Experience ist längst kein weicher Faktor mehr, sondern knallharter Rankingfaktor. Googles Core Web Vitals messen genau das: Wie schnell und reibungslos fühlt sich deine Website für einen echten Nutzer an?

Diese drei Metriken sind entscheidend:

- Largest Contentful Paint (LCP): Wie lange dauert es, bis das größte sichtbare Element geladen ist? Ein hoher LCP-Wert schreit dem Nutzer förmlich „Diese Seite ist langsam!“ ins Gesicht.

- First Input Delay (FID) / Interaction to Next Paint (INP): Wie schnell reagiert die Seite auf Klicks oder Eingaben? INP ist hier die neuere, aussagekräftigere Metrik, die FID langsam ablöst.

- Cumulative Layout Shift (CLS): Wie stabil ist das Layout beim Laden? Nichts ist nerviger als Elemente, die plötzlich herumspringen, kurz bevor man sie anklicken will.

Die Optimierung dieser Werte ist ein Muss für jede moderne technische SEO-Analyse. Die üblichen Verdächtigen sind riesige, unkomprimierte Bilder, zu viel JavaScript oder ein lahmender Server. Wenn du hier tiefer graben willst, schau dir unseren Guide zu den Google Core Web Vitals an, da gehen wir ins Detail.

Die Mobile-First-Welt annehmen

Die Realität ist: Die meisten Suchen finden auf dem Smartphone statt. Deshalb bewertet Google deine Website primär nach ihrer mobilen Version. Das ist das Prinzip des Mobile-First-Indexing. Deine Seite muss also nicht nur auf dem Desktop, sondern vor allem auf dem Handy eine gute Figur machen.

Ein responsives Design ist die absolute Grundlage. Aber es geht um mehr: Sind die Texte gut lesbar? Sind die Buttons groß genug und liegen nicht zu eng beieinander? Sind alle wichtigen Inhalte auch mobil verfügbar? Tools wie der „Mobile-Friendly Test“ von Google geben dir hier eine schnelle erste Einschätzung.

Weitere wichtige technische Säulen

Neben diesen großen Brocken gibt es noch ein paar weitere entscheidende Faktoren, die auf deine Checkliste gehören.

Strukturierte Daten (Schema.org) sind quasi ein Übersetzer für Google. Du hilfst der Suchmaschine, Inhalte wie Bewertungen, Preise oder FAQs besser zu verstehen. Der Lohn der Mühe sind oft auffällige Rich Snippets in den Suchergebnissen, die die Klickrate enorm steigern können.

Deine XML-Sitemap ist die offizielle Landkarte deiner Website für Google. Sie muss immer aktuell sein und darf nur indexierbare URLs enthalten. Reiche sie in der Google Search Console ein, damit Google auch wirklich alle relevanten Seiten auf dem Schirm hat.

Dein praxiserprobter Werkzeugkasten für die technische SEO-Analyse

Eine treffsichere technische SEO-Analyse ist keine Gefühlssache – sie braucht die richtigen Werkzeuge. Ein wirklich guter Werkzeugkasten ist dabei mehr als nur eine Software-Liste. Es ist eine strategisch zusammengestellte Sammlung von Tools, die sich gegenseitig ergänzen und dir so ein lückenloses Bild vom technischen Zustand deiner Website zeichnen.

Der Trick liegt darin, genau zu wissen, welches Tool für welchen Job das beste ist und wie man die Puzzleteile aus den verschiedenen Datenquellen clever zusammensetzt. Ohne diese Instrumente stocherst du im Nebel und läufst Gefahr, genau die kritischen Fehler zu übersehen, die deine Rankings ausbremsen.

Das Fundament: Die Google Search Console

Wenn es ein Tool gibt, das absolut unverzichtbar ist, dann ist es die Google Search Console (GSC). Sie ist dein direkter Draht zu Google, die offizielle Schnittstelle zwischen deiner Website und der Suchmaschine. Hier erfährst du aus erster Hand, wie Google deine Seiten sieht, sie crawlt und was am Ende im Index landet.

Für eine erste Diagnose ist die GSC unschlagbar. Sie liefert dir knallharte Fakten zu den wichtigsten Punkten:

- Abdeckung: Hier siehst du schwarz auf weiß, welche Seiten es in den Index geschafft haben und wo es hakt. Fehler wie „Gecrawlt – zurzeit nicht indexiert“ oder fiese 5xx-Serverfehler springen dir hier sofort ins Auge.

- Core Web Vitals: Vergiss Labordaten, hier bekommst du echte Nutzerdaten zur Performance. Die GSC zeigt dir schonungslos, welche URL-Gruppen bei LCP, INP oder CLS durchfallen.

- Nutzerfreundlichkeit auf Mobilgeräten: Da Google nach dem Mobile-First-Prinzip indexiert, ist dieser Bericht Gold wert. Er deckt alles auf, von zu kleiner Schrift bis hin zu Touch-Elementen, die zu eng beieinander liegen.

Sieh die GSC als dein Frühwarnsystem. Regelmäßig hier reinzuschauen, ist absolute Pflicht, um bei technischen Problemen nicht wochenlang hinterherzuhinken.

Für den tiefen Tauchgang: Der Screaming Frog SEO Spider

Während dir die GSC verrät, was Google sieht, lässt dich der Screaming Frog SEO Spider deine Website so sehen, wie es ein Crawler tut. Dieses Desktop-Tool ist ein Arbeitstier: Es kriecht systematisch durch jede einzelne URL und sammelt dabei eine unglaubliche Datenmenge. Für eine wirklich tiefgehende technische SEO-Analyse führt kein Weg daran vorbei.

Mit dem „Frog“ deckst du technische Schwachstellen im Handumdrehen auf:

- Finde auf Anhieb jeden kaputten Link (404-Fehler) und jede fehlerhafte Weiterleitung.

- Spüre Duplicate Content auf, indem du einfach nach doppelten Seitentiteln, Meta-Descriptions oder H1-Überschriften filterst.

- Prüfe mit wenigen Klicks, ob Canonical-Tags und

hreflang-Attribute sauber implementiert sind. - Analysiere deine interne Linkstruktur und entdecke Seiten, die völlig isoliert sind (sogenannte Orphan Pages).

Ein Tipp aus der Praxis: Kombiniere die Daten! Exportiere eine Liste von URLs mit Indexierungsproblemen aus der GSC. Anstatt deine ganze Seite zu crawlen, lässt du Screaming Frog gezielt nur diese Problem-URLs untersuchen. So kommst du der Ursache für die Indexierungsblockade viel schneller auf die Spur.

Performance im Fokus: Google PageSpeed Insights

Ladezeit ist kein nettes Extra – sie ist ein knallharter Rankingfaktor und absolut entscheidend für die User Experience. Google PageSpeed Insights (PSI) ist das Standard-Tool, um die Performance einer einzelnen Seite zu sezieren. Es liefert dir beides: Labordaten aus einer simulierten Messung und die wertvollen Felddaten von echten Nutzern aus dem Chrome User Experience Report.

Das Schöne an PSI ist, dass es nicht nur Probleme aufzeigt, sondern dir direkt priorisierte Handlungsempfehlungen an die Hand gibt. Typische To-dos sind hier das Komprimieren von Bildern, das Entfernen von ungenutztem JavaScript oder der Umstieg auf moderne Bildformate wie WebP.

Den Wettbewerb im Blick: Ahrefs und Semrush

Eine technische Analyse sollte niemals an der Grenze der eigenen Domain haltmachen. Tools wie Ahrefs oder Semrush sind perfekt, um auch die technische Fitness deiner Konkurrenten unter die Lupe zu nehmen. Du kannst dir ansehen, wie deren Seitenarchitektur aufgebaut ist, wie schnell deren Seiten laden oder ob sie strukturierte Daten vielleicht cleverer einsetzen als du.

Diese Einblicke sind unbezahlbar. Sie helfen dir, Benchmarks zu definieren und Potenziale zu entdecken, die auf deiner eigenen Seite noch brachliegen. Und falls du noch mehr Inspiration suchst: Eine tolle Übersicht weiterer nützlicher Helfer findest du in unserem Artikel über kostenlose SEO Analyse Tools.

Daten clever verknüpfen – Ein Beispiel aus dem Alltag

Stell dir vor, in deiner Search Console leuchtet für eine ganze Kategorie deines Online-Shops der Fehler „Gecrawlt – zurzeit nicht indexiert“ auf. Das ist ein klares Alarmsignal, aber die GSC allein verrät dir selten, warum das so ist.

Jetzt kommt das smarte Zusammenspiel der Tools ins Spiel:

- Der gezielte Einsatz von Screaming Frog: Du kopierst die betroffenen URLs aus der GSC und fütterst damit Screaming Frog für einen gezielten Crawl. Das Ergebnis: Du stellst fest, dass all diese Seiten eine sehr hohe Klicktiefe von der Startseite haben – oft mehr als 7 Klicks.

- Die Analyse der internen Links: Ein weiterer Blick in die Daten des Crawlers zeigt: Diese Produktseiten bekommen kaum interne Links ab. Sie hängen quasi verloren in der Seitenarchitektur.

- Die logische Schlussfolgerung: Google findet die Seiten zwar beim Crawlen, stuft sie aber aufgrund der schlechten internen Verlinkung und der hohen Klicktiefe als unwichtig ein. Um Crawl-Budget zu sparen, verzichtet die Suchmaschine daher auf die Indexierung.

Ohne die Kombination der beiden Tools hättest du dich vielleicht auf die falschen Ursachen gestürzt. Dein Werkzeugkasten entfaltet seine volle Kraft erst dann, wenn du lernst, die Instrumente im Konzert zu spielen und ihre Daten zu einem stimmigen Gesamtbild zusammenzufügen.

So gehst du bei einem technischen SEO-Audit richtig vor

Jetzt geht’s ans Eingemachte. Eine gründliche technische SEO-Analyse ist kein Hexenwerk, sondern ein klar strukturierter Prozess. Wichtig ist, dass du systematisch vorgehst, damit dir keine kritischen Fehler durch die Lappen gehen. Der Trick besteht darin, Daten aus verschiedenen Quellen zusammenzutragen, sie richtig zu deuten und daraus eine klare, priorisierte To-do-Liste zu machen.

Zuerst klären wir immer den Rahmen: Machen wir eine komplette Analyse für einen riesigen Online-Shop oder nur einen schnellen Check nach einem kleinen Website-Update? Das entscheidet, wie tief wir graben und welche Ressourcen wir einplanen.

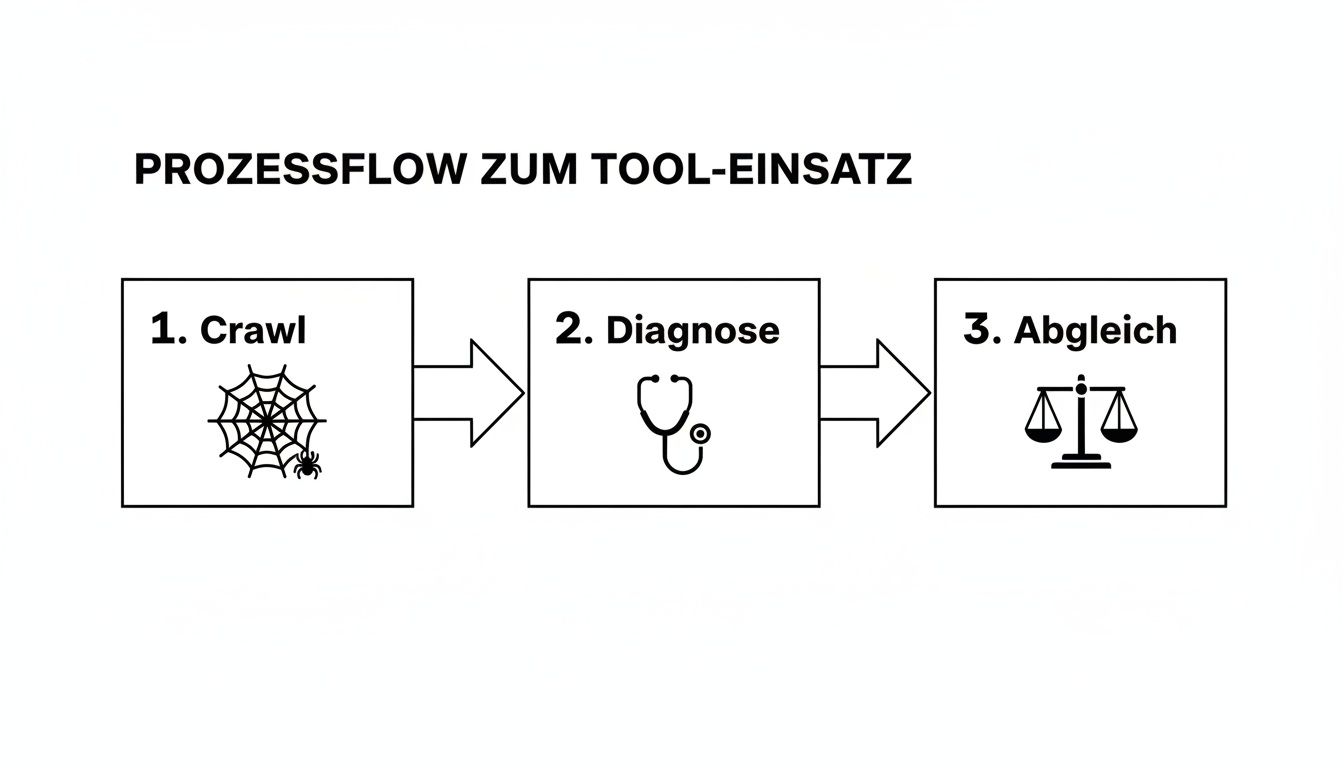

Die folgende Grafik zeigt den Kernprozess, der sich in der Praxis immer wieder bewährt hat. Er stützt sich auf drei ganz zentrale Säulen.

Dieser Dreiklang sorgt dafür, dass du nicht nur an Symptomen herumdokterst, sondern die echten Ursachen für technische Probleme findest und deine Entscheidungen auf soliden Daten basieren.

Der initiale Crawl als Bestandsaufnahme

Am Anfang steht immer ein vollständiger Crawl deiner Website. Dafür ist ein Tool wie der Screaming Frog SEO Spider perfekt. Der Crawler hangelt sich durch deine Seite, genau wie es ein Googlebot tun würde, und liefert dir eine riesige Datenmenge – die Grundlage für alles Weitere.

Konzentriere dich zuerst auf die typischen roten Flaggen, die sofort ins Auge springen. Dazu gehören:

- HTTP-Statuscodes: Halte Ausschau nach 404-Fehlern (Seite nicht gefunden) und 5xx-Serverfehlern. Besonders kritisch sind 404-Fehler auf Seiten, die wertvolle Backlinks haben. Die solltest du sofort per 301-Weiterleitung umbiegen.

- Canonical-Tags: Sind sie auf allen wichtigen Seiten gesetzt? Zeigen sie auch wirklich auf die richtige URL, die indexiert werden soll? Falsche Canonicals sind ein Klassiker, wenn es um Duplicate Content geht.

- Indexierbarkeit: Filter einfach mal nach allen Seiten, die ein „noindex“-Tag haben. Manchmal findet man hier noch Überbleibsel aus der Entwicklungsphase, die versehentlich wichtige Inhalte von Google fernhalten.

Dieser erste Durchlauf gibt dir ein gutes Gefühl für den allgemeinen Gesundheitszustand deiner Seite. Notiere dir alle Auffälligkeiten, auch wenn du sie erst später im Detail untersuchst.

Realitätscheck: Der Indexierungsstatus in der Google Search Console

Nachdem du deine Website durch die Brille eines Crawlers gesehen hast, kommt der Realitätscheck in der Google Search Console (GSC). Hier siehst du, wie Google deine Seite wirklich wahrnimmt und was tatsächlich im Index landet. Dein wichtigster Anlaufpunkt dafür ist der Bericht „Seiten“ (früher „Abdeckung“).

Schau dir unbedingt auch die URLs an, die als „Ausgeschlossen“ markiert sind. Hier verbergen sich oft die spannendsten Erkenntnisse. Eine hohe Anzahl von Seiten unter „Gecrawlt – zurzeit nicht indexiert“ kann zum Beispiel ein Hinweis darauf sein, dass Google deine Inhalte für nicht relevant oder qualitativ zu schwach hält.

Ein typischer Fallstrick sind parametrisierte URLs, die durch Filternavigationen in Online-Shops entstehen. Werden die nicht sauber über Canonical-Tags oder die robots.txt gesteuert, verpulvern sie Crawl-Budget und erzeugen massenhaft Duplicate Content.

Prüfe auch, ob deine in der GSC hinterlegte XML-Sitemap aktuell ist und keine fehlerhaften URLs enthält. Eine saubere Sitemap ist ein wichtiges Signal an Google. Wenn du tiefer in das Thema einsteigen willst, findest du in unserem Guide zum Thema sitemap.xml Erstellen wertvolle Praxistipps.

Performance und mobile Darstellung unter der Lupe

Die User Experience ist mittlerweile ein knallharter Rankingfaktor. Starte eine Analyse der Core Web Vitals mit Google PageSpeed Insights. Teste aber nicht nur die Startseite, sondern auch wichtige Kategorieseiten, ein paar Produkte oder deine Top-Blogartikel.

Die üblichen Performance-Bremsen sind oft schnell gefunden:

- Riesige, unkomprimierte Bilder: Meist der einfachste Hebel mit der größten Wirkung, um die Ladezeit zu verbessern.

- Unbenutztes JavaScript und CSS: Code, der geladen, aber gar nicht gebraucht wird, bremst die Seite unnötig aus.

- Lahme Server-Antwortzeiten (TTFB): Wenn der Server selbst langsam ist, bringen auch Optimierungen am Frontend nur bedingt etwas.

Gleichzeitig musst du die mobile Darstellung auf dem Schirm haben. Nutze den „Test auf Optimierung für Mobilgeräte“ von Google für eine schnelle Einschätzung. Noch besser: Nimm dein Smartphone und klicke dich selbst durch die Seite. Sind alle Buttons gut bedienbar? Ist die Schrift lesbar? Funktioniert der Warenkorb reibungslos?

Befunde dokumentieren und clever priorisieren

Die reine Datensammelei ist nur die halbe Miete. Der entscheidende Schritt ist, die gefundenen Probleme richtig zu interpretieren und zu priorisieren. Ohne eine klare Einordnung verlierst du dich schnell in Details und verschwendest wertvolle Ressourcen.

Erstelle eine simple Tabelle, in der du jeden Befund festhältst. Wichtig sind Spalten für die Priorität und den geschätzten Aufwand für die Umsetzung.

| Problembeschreibung | Bereich | Priorität | Aufwand (Entwicklung) |

|---|---|---|---|

| robots.txt blockiert /kategorie/ | Crawling | Kritisch | Gering |

| LCP bei Produktseiten > 4s | Performance | Hoch | Mittel |

| 50 Alt-Tags bei Bildern fehlen | On-Page | Mittel | Gering |

| Canonical-Tags fehlen bei URLs | Indexierung | Hoch | Mittel |

Diese Struktur hilft dir enorm, den Überblick zu behalten und deine Ressourcen genau dort einzusetzen, wo sie den größten Hebel haben.

Ein kritischer Fehler wie eine falsche robots.txt-Regel, die wichtige Seiten blockiert, muss sofort behoben werden. Ein hoher LCP-Wert ist ebenfalls dringend, da er sich direkt auf Rankings und Conversions auswirkt. Fehlende Alt-Tags sind zwar wichtig, haben aber eine geringere Priorität als ein fundamentales Indexierungsproblem. Genau diese Unterscheidung macht eine effektive technische SEO-Analyse aus.

So werden aus Daten Taten: Ergebnisse verständlich aufbereiten und die Umsetzung steuern

Die gründlichste technische SEO-Analyse bringt rein gar nichts, wenn die Ergebnisse in einem komplizierten Report verstauben und niemand weiß, was zu tun ist. Der wahre Wert deiner Arbeit zeigt sich erst dann, wenn du es schaffst, aus all den Daten verständliche und umsetzbare Handlungsempfehlungen zu formen. Empfehlungen, die nicht nur das Management überzeugen, sondern dem Entwicklungsteam auch eine glasklare Anleitung an die Hand geben.

Deine Mission ist es, eine Brücke zu bauen – zwischen der technischen Komplexität und den knallharten Business-Zielen. Statt nur zu sagen „Der LCP-Wert ist schlecht“, musst du das Problem in eine Sprache übersetzen, die jeder im Unternehmen versteht.

Die Kunst, technische Probleme zu übersetzen

Ganz ehrlich: Technische Metriken sind für Entwickler. Für Entscheider musst du sie in den Kontext von Umsatz, Leads und Nutzererfahrung rücken. Deine Aufgabe ist es, die Frage „Warum sollten wir dafür Zeit und Geld ausgeben?“ proaktiv zu beantworten, bevor sie überhaupt gestellt wird.

Verknüpfe technische Fehler also immer direkt mit den Auswirkungen auf das Geschäft. Hier sind ein paar Beispiele aus der Praxis, wie du komplexe Befunde greifbar machst:

Statt: „Wir haben viele 404-Fehler auf Seiten mit eingehenden Backlinks.“

Besser: „Aktuell verlieren wir wertvolle Link-Autorität, weil 15 % unserer Backlinks ins Leere laufen. Das ist, als würden wichtige Partner Empfehlungen für uns aussprechen, wir diese aber einfach ignorieren. Das schwächt unser gesamtes Ranking-Potenzial.“

Statt: „Der LCP-Wert liegt bei 4,2 Sekunden.“

Besser: „Unsere Produktseiten brauchen mehr als 4 Sekunden zum Laden. Studien zeigen, dass allein eine Sekunde schnellere Ladezeit die Conversion-Rate um bis zu 7 % steigern kann. Im Moment verlieren wir also potenzielle Kunden, noch bevor sie überhaupt unsere Produkte zu Gesicht bekommen.“

Dieser Perspektivwechsel verändert die gesamte Diskussion. Aus einem trockenen Mangel wird eine handfeste Geschäftschance oder ein vermeidbares Risiko.

Der Aufbau eines wirkungsvollen Audit-Berichts

Ein guter Report ist wie ein guter Übersetzer: Er spricht mehrere Sprachen und bedient die Bedürfnisse ganz unterschiedlicher Leute. Er muss dem Management den strategischen Überblick geben und gleichzeitig präzise, technische Details für die Umsetzung liefern.

Ein Aufbau, der sich in der Praxis bewährt hat, sieht so aus:

- Management Summary: Eine einzige Seite, die alles Wichtige auf den Punkt bringt. Hier nennst du die drei kritischsten Probleme, ihre geschäftlichen Folgen und die Top-Maßnahmen zur Lösung – kurz, prägnant und frei von Fachjargon.

- Detaillierte Befunde nach Priorität: Jetzt geht’s ans Eingemachte. Gruppiere die gefundenen Probleme thematisch (z. B. Crawling, Performance, Indexierung) und ordne sie nach Dringlichkeit. So weiß jeder, wo es am meisten brennt.

- Konkrete Handlungsempfehlungen: Das ist der wichtigste Teil für die Entwickler. Beschreibe nicht nur das Problem, sondern vor allem die Lösung. Gib klare Anweisungen, füge Screenshots hinzu und verlinke, wo es sinnvoll ist, auf offizielle Dokumentationen oder hilfreiche Tools.

Ein effektiver Audit-Bericht ist kein reines Problemdokument, sondern ein Lösungsleitfaden. Er beantwortet nicht nur die Frage „Was ist kaputt?“, sondern vor allem „Wie reparieren wir es und was bringt uns das?“.

Priorisierung ist alles

Dein Audit wird wahrscheinlich eine lange Mängelliste zutage fördern. Der Versuch, alles auf einmal anzugehen, führt unweigerlich zu Frust und Stillstand. Der Schlüssel zum Erfolg liegt in einer smarten Priorisierung.

Eine einfache Matrix hilft dabei, die Aufgaben zu bewerten:

| Kriterium | Beschreibung |

|---|---|

| Auswirkung | Wie stark beeinflusst das Problem die SEO-Performance oder die Geschäftsziele? (Hoch, Mittel, Gering) |

| Aufwand | Wie viel Zeit und Ressourcen braucht es für die Behebung? (Hoch, Mittel, Gering) |

Fang immer mit den Aufgaben an, die eine hohe Auswirkung bei geringem Aufwand haben. Das sind deine „Quick Wins“. Sie liefern schnelle Ergebnisse, schaffen Vertrauen und bauen das Momentum für die größeren, zäheren Projekte auf. Ein blockierender Eintrag in der robots.txt ist hierfür ein klassisches Beispiel.

Danach knöpfst du dir die Aufgaben mit hoher Auswirkung und hohem Aufwand vor. Diese Brocken erfordern oft eine detailliertere Planung und mehr Ressourcen. Deine Aufgabe ist es, durch die saubere Aufbereitung der Daten die nötige Überzeugungsarbeit zu leisten. Datenvisualisierungen, etwa eine Grafik, die den Zusammenhang zwischen Ladezeit und Absprungrate aufzeigt, sind hier Gold wert, um komplexe Sachverhalte auf einen Blick verständlich zu machen.

Häufige Fragen zur Technischen SEO-Analyse

Bei technischen SEO-Audits tauchen in der Praxis immer wieder dieselben Fragen auf. Ich habe hier mal die häufigsten gesammelt und gebe dir Antworten direkt aus unserem Agenturalltag – damit du typische Fallstricke von vornherein vermeidest.

Wie oft sollte ich eine technische SEO-Analyse durchführen?

Die perfekte Frequenz gibt es nicht – sie hängt komplett davon ab, wie dynamisch deine Website ist. Aber es gibt eine gute Faustregel, an der du dich orientieren kannst.

Betreibst du eine sehr aktive Seite wie einen großen E-Commerce-Shop oder ein Nachrichtenportal, auf der ständig neue Inhalte, Produkte oder Funktionen dazukommen? Dann ist ein monatlicher Check absolut sinnvoll. So spürst du kleine Fehler auf, bevor sie sich zu einem echten Problem auswachsen.

Für die meisten Unternehmenswebsites oder Blogs, bei denen sich an der Grundstruktur nicht wöchentlich etwas ändert, reicht ein umfassendes Audit pro Quartal völlig aus. Das gibt dir genug Zeit, um Trends zu erkennen und gezielt gegenzusteuern.

Ein Ratschlag aus der Praxis: Unabhängig von deinem regulären Rhythmus solltest du immer einen sofortigen technischen Check machen, wenn ein großer Relaunch, ein wichtiges System-Update oder eine Migration ansteht. Genau bei solchen Aktionen passieren die meisten unbemerkten SEO-Katastrophen.

Was ist der Unterschied zwischen einem technischen Audit und einem On-Page-Audit?

Diese Frage sorgt oft für Verwirrung, dabei ist die Abgrenzung recht einfach. Stell dir deine Website wie ein Haus vor, das du für wichtige Besucher – in diesem Fall die Suchmaschinen-Crawler – vorbereitest.

- Das technische Audit prüft das Fundament und die Infrastruktur des Hauses. Ist das Fundament stabil (Server-Performance)? Ist die Eingangstür leicht zu finden und breit genug (Crawlbarkeit)? Funktionieren alle Leitungen (keine Serverfehler)? Es geht also um die grundlegende Stabilität und Erreichbarkeit.

- Das On-Page-Audit kümmert sich dagegen um die Einrichtung der einzelnen Zimmer. Sind die Wegweiser klar (Seitentitel, Meta-Beschreibungen)? Sprechen die Inhalte die richtige Sprache (Keyword-Verwendung)? Ist die Deko ansprechend und sinnvoll platziert (Bilder, interne Links)?

Beide Audits sind für den Erfolg entscheidend und bauen aufeinander auf. Denn das schönste Wohnzimmer bringt nichts, wenn das Fundament des Hauses bröckelt.

Welche drei Fehler haben die schlimmsten Auswirkungen?

Aus unserer Erfahrung kristallisieren sich immer wieder drei kritische Fehler heraus, die Rankings am schnellsten und nachhaltigsten ruinieren. Wenn du also nur begrenzte Ressourcen hast, konzentriere dich zuerst auf diese potenziellen Showstopper.

- Falsche Indexierungsanweisungen: Nichts ist fataler als ein versehentlich gesetzter

noindex-Tag oder eine zu großzügigeDisallow-Regel in der robots.txt. Solche Fehler können ganze Bereiche deiner Website – im schlimmsten Fall die komplette Domain – für Google unsichtbar machen. - Massive Performance-Probleme: Ein extrem langsamer Largest Contentful Paint (LCP) ist nicht nur ein direkter Rankingfaktor, sondern auch ein absoluter Conversion-Killer. Wenn deine Seite ewig lädt, springen Nutzer ab, bevor sie den Inhalt überhaupt sehen – ein katastrophales Signal für Google.

- Unkontrollierter interner Duplicate Content: Wenn durch Filter, Parameter oder CMS-Fehler unzählige Versionen derselben Seite entstehen, ohne dass saubere Canonical-Tags gesetzt sind, verbrennt das dein wertvolles Crawl-Budget. Google weiß dann nicht, welche Version es ranken soll, und die Autorität deiner wichtigsten Seiten wird massiv verwässert.

Eine saubere technische Basis ist kein "Nice-to-have", sondern das Fundament für nachhaltigen SEO-Erfolg. Wenn du Unterstützung von Experten suchst, die deine Website von Grund auf stabilisieren, dann ist LinkITUp der richtige Partner. Wir sorgen dafür, dass deine Inhalte die Sichtbarkeit bekommen, die sie verdienen. Erfahre mehr und erreiche deine Ziele mit uns unter https://seobuchen.com/.